- Författare Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:53.

- Senast ändrad 2025-01-22 17:41.

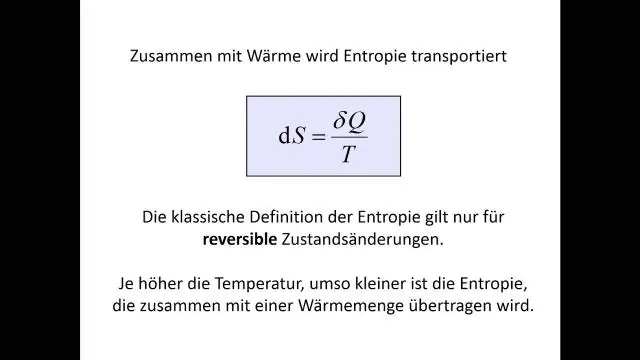

Entropi : A beslutsträd byggs uppifrån och ned från en rotnod och innebär att data partitioneras i delmängder som innehåller instanser med liknande värden (homogena). ID3 algoritm använder entropi för att beräkna homogeniteten hos ett prov.

Folk frågar också, vad är definitionen av entropi i maskininlärning?

Entropi , som det avser maskininlärning , är ett mått på slumpmässigheten i den information som behandlas. Ju högre entropi , desto svårare är det att dra några slutsatser från den informationen. Att slå ett mynt är ett exempel på en handling som ger information som är slumpmässig. Detta är kärnan i entropi.

Förutom ovan, vad är informationsvinst och entropi i beslutsträdet? De informationsvinst baseras på minskningen av entropi efter att en datauppsättning delas på ett attribut. Att bygga en beslutsträd handlar om att hitta attribut som ger högst informationsvinst (d.v.s. de mest homogena grenarna). Resultatet är Informationsvinst , eller minska i entropi.

Vet också, vad är minimivärdet för entropi i ett beslutsträd?

Entropi är lägst vid ytterligheterna, när bubblan antingen inte innehåller några positiva instanser eller bara positiva instanser. Det vill säga när bubblan är ren är störningen 0. Entropi är högst i mitten när bubblan är jämnt fördelad mellan positiva och negativa instanser.

Vad är entropi i slumpmässig skog?

Vad är entropi och varför informationsvinst spelar roll Beslut Träd? Nasir Islam Sujan. 29 juni 2018 · 5 min läst. Enligt Wikipedia, Entropi hänvisar till störning eller osäkerhet. Definition: Entropi är måtten på orenhet, oordning eller osäkerhet i ett gäng exempel.

Rekommenderad:

Vilken är den bästa definitionen av en säkerhetsmodell?

En säkerhetsmodell är en teknisk utvärdering av varje del av ett datorsystem för att bedöma dess överensstämmelse med säkerhetsstandarder. D. En säkerhetsmodell är processen för formellt godkännande av en certifierad konfiguration

Hur fungerar beslutsträdet i R?

Beslutsträd är en typ av övervakad inlärningsalgoritm som kan användas i både regressions- och klassificeringsproblem. Det fungerar för både kategoriska och kontinuerliga in- och utvariabler. När en undernod delas upp i ytterligare undernoder kallas den för en beslutsnod

Vilken av följande är den bästa definitionen av interoperabilitet?

Interoperabilitet är förmågan hos olika IT-system och mjukvaruapplikationer att kommunicera, att utbyta data korrekt, effektivt och konsekvent och att använda informationen som har utbytts. Det är grundläggande för framgången med EPJ

Vilken är den bästa definitionen av ordet quizzical?

Frågesport betyder vanligtvis förbryllad eller ifrågasättande, även om det också kan betyda förvirrad, förvånad, komisk eller hånfull. Om någon tittar på dig med ett frågetecken när du nämner din sommar, kan det betyda att de inte vet om dina äventyr på rymdlägret

Vilken är den bästa definitionen av metakommunikation?

Metakommunikation är alla icke-verbala signaler (ton i rösten, kroppsspråk, gester, ansiktsuttryck, etc.) som bär betydelse som antingen förstärker eller förbjuder det vi säger i ord. Det pågår en hel konversation under ytan